IA y Educación: Experiencias de Aula, Modelos LLM Open Source, Ética y Control de Plagios

Este artículo pertenece a una serie donde cada semana comparto una selección curada de lecturas sobre Inteligencia Artificial y Educación. Espero que te resulte interesante. Si quieres estar al tanto de cada nueva publicación te recomiendo que o bien te suscribas al feed del blog con una herramienta como feedly, o bien te suscribas vía e-mail [acabamos de alcanzar los 1600 suscriptores por correo-e]. Encontrarás ambas opciones en la columna lateral 👉

La semana pasada cerramos el artículo resumen con la presentación por parte de Google de Gemini, con todo el hype que generó, fundamentalmente por un vídeo en el que se presumían una serie de capacidades para esta familia de modelos de IA multimodales que finalmente, al menos por el momento, no son tal y como parecían. En palabras de Carlos Santana, Gemini es un GPT4, quizá ligeramente superior en algunos aspectos. Prácticamente en paralelo, la startup de inteligencia artificial de código abierto fundada por Arthur Mensch [ex-ingeniero de DeepMind] junto a Guillaume Lample y Timothée Lacroix [investigadores de Meta], Mistral AI, libera en Twitter/X mediante un enlace magnet torrent el primer modelo MoE [Mixture of Experts] de código abierto. En su última ronda de financiación esta startup han conseguido 385 millones de euros y su valor actual está en torno a los 2.000 millones de dólares.

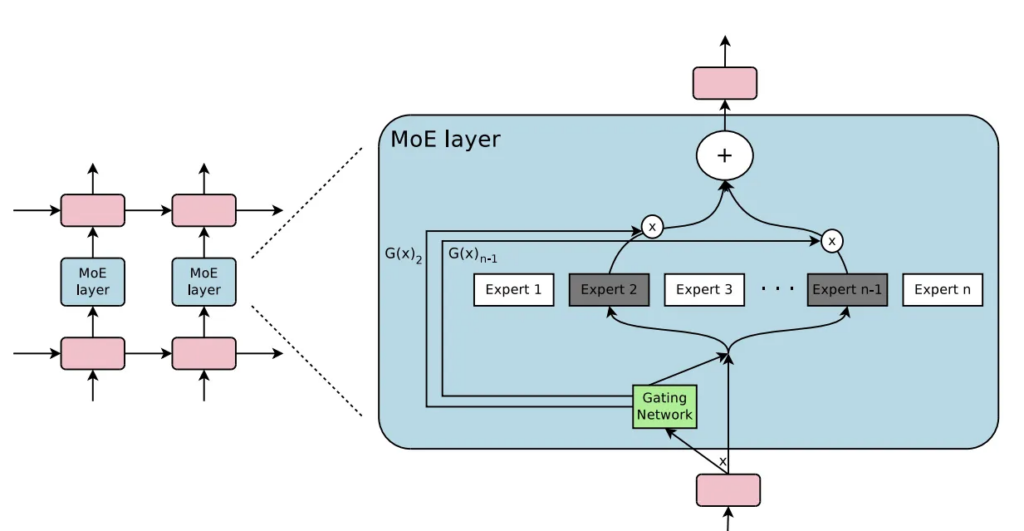

MoE es una técnica utilizada en grandes modelos de lenguaje [LLM] para mejorar su eficiencia y precisión, dividiendo tareas complejas en subtareas más pequeñas y manejables, cada una asignada a redes neuronales más pequeñas entrenadas para ser altamente especializadas en áreas específicas. Este tipo de modelos incluyen por tanto una capa de expertos y una red de compuertas que es la encargada de tomar decisiones en la arquitectura, evaluando qué experto es el más adecuado para un determinado dato de entrada. ¿Quién pensaba que el final de año iba a ser aburrido en términos de noticias sorprendentes sobre nuevos desarrollos de IA?

La filosofía de Mistral es similar a la que Meta ha adoptado al liberar como Open Source su LLM Llama 2. Estos dos modelos aún no están a la altura de GPT4, así es que parece que han optado por modelos sostenidos por la comunidad de desarrolladores de software libre, ya que por el momento no pueden competir con los principales modelos. Así es que tanto la liberación de Meta 2 como la publicación del modelo de Mistral son buenas noticias para la innovación y el conocimiento abierto en el ámbito de la Inteligencia Artificial, ya que, como dice Xabier Barandiaran «deberíamos gestionar la Inteligencia Artificial como un patrimonio público y común».

La filosofía de Mistral es similar a la que Meta ha adoptado al liberar como Open Source su LLM Llama 2. Estos dos modelos aún no están a la altura de GPT4, así es que parece que han optado por modelos sostenidos por la comunidad de desarrolladores de software libre, ya que por el momento no pueden competir con los principales modelos. Así es que tanto la liberación de Meta 2 como la publicación del modelo de Mistral son buenas noticias para la innovación y el conocimiento abierto en el ámbito de la Inteligencia Artificial, ya que, como dice Xabier Barandiaran «deberíamos gestionar la Inteligencia Artificial como un patrimonio público y común».

Continuamos con un par lecturas pendientes que se quedaron fuera del último resumen. Comenzamos con un artículo de Andy Extance para Nature: ChatGPT has entered the classroom: how LLMs could transform education. Según el autor, los grandes modelos de lenguaje [LLM] como ChatGPT podrían utilizarse para ahorrar tiempo en la lectura y resumen de textos extensos, estimular el pensamiento crítico y la creatividad, y guiar a los aprendices a través de problemas paso a paso. Sin embargo, también plantea las preocupaciones entre el profesorado sobre el riesgo de que el alumnado utilice estos modelos para «hacer trampa» en sus tareas y se vuelvan dependientes de ellos para obtener respuestas rápidas sin comprender el razonamiento. Por otra parte plantea los problemas de privacidad, ya que los datos ingresados en los LLM pueden ser almacenados y utilizados para entrenar los modelos. A pesar de estos desafíos, indica el autor que muchos investigadores y educadores ven un gran potencial en los LLM para mejorar la educación, y que la sociedad debe ayudar a los estudiantes a comprender las fortalezas y riesgos de los LLM, en lugar de prohibir su uso. Aunque viendo las últimas novedades en España con la prohibición de móviles en el aula, mucho me temo que estamos lejos de adoptar políticas educativas realmente ambiciosas en este sentido.

Otro interesante artículo, How Should Teachers Be Using AI? UNESCO Believes It Could Solve Education’s Biggest Challenges, de Danielle Summer, recoge la apuesta de UNESCO por la inteligencia artificial para resolver los mayores desafíos a los que actualmente se enfrentan los sistemas educativos, al permitir al profesorado mejorar los resultados de los estudiantes, personalizar la enseñanza y hacer que la educación sea más accesible. En este sentido, UNESCO se ha propuesto promover el uso de la inteligencia artificial en la enseñanza a escala global para mejorar el acceso al conocimiento, la investigación y la educación que se centra en la diversidad de expresiones culturales. Ya hemos recomendado anteriormente diferentes documentos publicados por UNESCO sobre IA. Merece la pena dar una vuelta por el apartado de IA de esta organización.

En la página CODE de INTEF podemos encontrar propuestas didácticas y experiencias de pensamiento computacional e inteligencia artificial para llevar al aula, desarrolladas por profes de diferentes niveles educativos. Destacamos algunas de las más interesantes:

- Recicla con IA [Primaria/ESO] es una actividad diseñada por Álvaro Molina, miembro del equipo de tutores del curso de Inteligencia Artificial de Conecta13. En esta actividad, a lo largo de 12 sesiones, el alumnado es capaz de configurar un artefacto computacional usando Scratch y la plataforma LearningML para diferenciar distintos tipos de residuos.

- Diseño de chats asistenciales [Primaria/ESO/Bachillerato/FP] es una actividad diseñada por Fernando Posada que permite al alumnado aprender a crear y utilizar Watson Assistant, una herramienta en línea de inteligencia artificial de la suite IBM Cloud, para diseñar, crear y poner en funcionamiento un chatbot destinado a brindar ayuda a las familias que acceden a la página web del colegio.

- Control de una placa programable usando la voz [Primaria], permite al alumnado poner en marcha un sistema para controlar una placa micro:bit a través de órdenes habladas a través de un modelo de aprendizaje automático de sonido, haciendo uso de Teachable Machine y Strech3. Conviene familiarizarse previamente con la creación de modelos de Teachable Machine [una herramienta de Google], para lo que este otro recurso de CodeINTEF puede venir bien.

- Inteligencia Artificial y la Historia de España [Primaria] es una actividad diseñada por Pablo Dúo Terrón que se desarrolla a lo largo de seis sesiones, enmarcada en el área de Ciencias Sociales para 6º de Primaria, en la que el alumnado aprende mediante Machine Learning, bloques de programación y programación «No Code».

Además de experiencias de aula, en la página CodeINTEF puedes acceder otro tipo de contenidos también relacionados con la IA: informes, artículos, etc.

Rumbo a la IA: Una aventura algorítmica es una novela gráfica de la UNESCO dirigida a jóvenes para promover la conciencia sobre la IA. A través de cuatro historias podemos acompañar a cuatro personajes [Ari, Maryam, Shirin y Joaquín] por diferentes lugares del mundo para entender mejor los resto de los algoritmos, la conectividad permanente y el flujo de datos continuo, los sistemas de recomendación, los sesgos de la IA y otros problemas éticos. Cada una de las cuatro historias cuenta con una introducción, un glosario de términos y unas conclusiones finales.

Rumbo a la IA: Una aventura algorítmica es una novela gráfica de la UNESCO dirigida a jóvenes para promover la conciencia sobre la IA. A través de cuatro historias podemos acompañar a cuatro personajes [Ari, Maryam, Shirin y Joaquín] por diferentes lugares del mundo para entender mejor los resto de los algoritmos, la conectividad permanente y el flujo de datos continuo, los sistemas de recomendación, los sesgos de la IA y otros problemas éticos. Cada una de las cuatro historias cuenta con una introducción, un glosario de términos y unas conclusiones finales.

Mariana Ferrarelli compartía esta semana un documento fruto del trabajo de la Representación Especial para la Política Exterior Feminista [REPEF], una iniciativa del gobierno argentino saliente: Aportes Feministas en Inteligencia Artificial. Este documento recoge el eje 4 de la hoja de ruta desarrollada por la REPEF, y se organiza en varios bloques: desafíos de la implementación de recomendaciones éticas de la IA, mujeres en los desarrollos y diseño de IA o infraestructuras y tareas de cuidado, entre otros. Así podemos leer desde artículos sobre prevención algorítmica de embarazos adolescentes hasta sociedad artificial y pensamiento sistémico para las IA. Especialmente interesante la aportación de Marian, con una lúcida reflexión sobre el significado de la alfabetización digital y mediática en tiempos de las IAs generativas [a partir de la pág. 43].

De Kai, profesor de informática e ingeniería en la Universidad de Ciencia y Tecnología de Hong Kong, nos plantea la pregunta crucial sobre la IA que no nos estamos haciendo: ¿tiene sentido trabajar sobre modelos de desarrollo de la inteligencia artificial que buscan la alineación de estos con los objetivos de la humanidad si ni siquiera tenemos claros cuáles son dichos objetivos? Claramente hay una cuestión ética de mayor profundidad previa a pensar y desarrollar IAs.

Cambiando de tercio, el año pasado, más o menos por estas fechas, Carlos Santana protagonizó una de las charlas más interesantes del EduTech Congress, hablando por supuesto de Inteligencia Artificial. Allí ya nos comentó que por el momento era imposible detectar plagios realizados con herramientas de IA, incluso usando herramientas de IA para ello.

Sin embargo no hay más que darse una vuelta por Google para ver la cantidad de webs que pretenden vender herramientas para identificar contenidos generados por IA, cuando no directamente te aseguran que son capaces de identificar plagios, aunque varias instituciones académicas han cuestionado la fiabilidad de herramientas de este tipo.

Hace tan sólo unos días César Poyatos hizo su propia prueba del algodón y este es el resultado [spoiler después del tweet, por si acaso no tienes tiempo de leer el hilo completo]:

¿Te preocupa el plagio en los trabajos académicos de tu estudiantado? ¿Quieres saber si se pueden detectar proyectos generados con IA?🔍📝.

He probado el detector GPTZero. 🔗LINK, pruebas, ejemplos y conclusiones en este hilo 🧵👇.#InteligenciaArtificial #IA #AI #plagio pic.twitter.com/4uREpYnNuJ

— César Poyatos (@cpoyatos) December 6, 2023

Si no tienes tiempo de leer el hilo completo, la conclusión de César es que no hay nada que hacer. Y propone «…tal vez sería conveniente educar en un buen uso, en un uso ético y responsable».

Terminamos con un par de recomendaciones más. Muy recomendable IA Educativa, un sitio de Google en el que Ramón Besonías ha organizado numerosos recursos sobre IA y Educación. Además de herramientas organizadas por categorías, prompts, tutoriales o GPTs, encontrarás enlaces a un canal de Telegram, un blog y un grupo de Facebook.

Por su parte, Cristóbal Calderón [orientador en el IES Gabriel García Márquez de Madrid] ha puesto en marcha un blog con contenidos sobre Inteligencia Artificial en el ámbito de la Orientación Educativa y Profesional. En este blog podemos encontrar un apartado con varias guías de uso de la IA, además de una interesante selección de artículos que recorre diversas posibilidades de uso de la inteligencia artificial en ámbitos específicos de la orientación como adaptaciones curriculares o altas capacidades.

¡Buen fin de semana!

Imagen de cabecera | Generada por GPT4 con el prompt «Imagen apaisada con una vista cenital de un aula donde el alumnado está trabajando por proyectos». Prompt creado por GPT4: ‘A wide aerial view of a classroom with students of various descents, including Caucasian, Asian, Black, Hispanic, and Middle-Eastern, engaging in project-based learning. The scene shows groups of students gathered around tables, collaborating on different projects. Each group is focused on various materials and tools relevant to their projects, like laptops, books, construction paper, and models. The classroom is arranged to facilitate teamwork, with open spaces and seating that allows students to face each other. The lighting is bright, and the walls are decorated with educational posters, emphasizing a creative and collaborative learning environment.’